Waldl: Wir sprechen von einer mikrosekundengenauen Synchronisierung zwischen Kamera, Beleuchtung, Steuerung und Antrieben sowie einem Jitter von 100ns. Nur so lassen sich Bildeinzug und Lichtblitz so steuern, dass die Geschwindigkeit des Maschinenprozesses nicht beeinträchtigt wird.

Dr. Olaf Munkelt (MVTec Software): Für Bildverarbeiter ist Echtzeit die Zeit, die es braucht, um einen Zyklus zu durchlaufen und das ist – je nach Anwendung – völlig unterschiedlich. Das kann beim Barcodelesen 5ms sein, aber bei einer komplexen Robot-Vision-Lösung auch 500ms oder mehr.

Dr. Klaus Henning Noffz (Silicon Software): Echtzeit bedeutet, dass ich eine garantierte Reaktionszeit habe. Es gibt durchaus Anwendungen, die eine Reaktion unterhalb einer Mikrosekunde erfordern. Wir haben auf der Vision ein System gezeigt, das mit Deep Learning eine Klassifikation macht und eine Jitter-freie garantierte Reaktion/Klassifikation erreicht. Diese liegt im Bereich von mehreren Nanosekunden im Prinzip mit einem Jitter und einer Reaktion von einigen Mikrosekunden.

Rainer Schönhaar (Balluff): Wenn ich sehr schnelle Prozesse habe, kann das schon im Milli- oder Mikrosekundenbereich sein. Die Beleuchtung und Bildaufnahmen müssen so schnell erfolgen, wie es die Dynamik des Automatisierungsprozesses und der Objektanwesenheit erlaubt. Die andere Frage ist aber, bis wann ich ein Ergebnis benötige?

Waldl: Bei der Reaktionszeit mit einer FPGA-Lösung habe ich den Vorteil, dass ich die Reaktionszeit steuern kann, das heißt mit mehr Rechenleistung, verschiedenen Hardwarearchitekturen oder Algorithmen. Die Echtzeitfähigkeit bei einer Triggersituation erreiche ich nur, wenn das Vision-System in das Automatisierungssystem komplett integriert ist. Dort muss ich auch auf die harten Echtzeitanforderungen der Antriebs- und Automatisierungstechnik reagieren, und daraus ergibt sich mein Triggerzeitpunkt.

Keppler: Das Ergebnis der Bildverarbeitung muss rechtzeitig zur Verfügung stehen. Der Maschinentakt definiert dabei, was ‚rechtzeitig‘ ist, um beispielsweise Fehlerteile auszuschleusen.

Schönhaar: Wenn man aus Bildverarbeitungssicht sagt „ich hab eine Aufgabe abgeschlossen“, dann kann diese Aufgabe eventuell aber für die SPS zu diesem Zeitpunkt noch nicht erledigt sein. Wir müssen also neben der Laufzeit der Bildverarbeitung auch zusätzlich die Übertragungszeiten mit berücksichtigen.

Welche Möglichkeiten gibt es, die Usability von Vision-Systemen zu vereinfachen?

Schönhaar: Wir benutzen die Halcon-Bibliothek und machen eine Art eigenen ‚Dialekt‘ darüber, das heißt die Bedienung der (Smart-) Kamerasysteme so weit benutzerfreundlich, dass wir in deren Sprachgebrauch gehen: „Ich möchte einen Text lesen, ein Teil verifizieren oder finden.“ Das ist etwas anderes, als wenn man sagt „ich möchte eine Kante finden“. Natürlich gibt es hier Grenzen, für die wir dann einen Expert Mode mit zusätzlichen Parametern haben.

Waldl: Es geht darum, das Lösen der kompletten Bildverarbeitungslösung so einfach wie möglich zu machen. Daher haben wir die komplette Bildverarbeitung in die vorkonfigurierten Softwarebausteine von Mapp Vision integriert. Diese kommunizieren wiederum automatisch mit allen anderen Mapp-Bausteinen. Wenn ich es schaffe, ein Licht einfach zu parametrieren, z.B. den Winkel der Beleuchtung zu parametrieren und softwareseitig wiederholbar genau einzustellen oder Systeme in der Maschinenvisualisierung ohne ein zusätzliches Bedienterminal darstellen kann, da es Bestandteil der Visualisierung ist – dann habe ich die Usability für den Maschinenbauer deutlich vereinfacht.

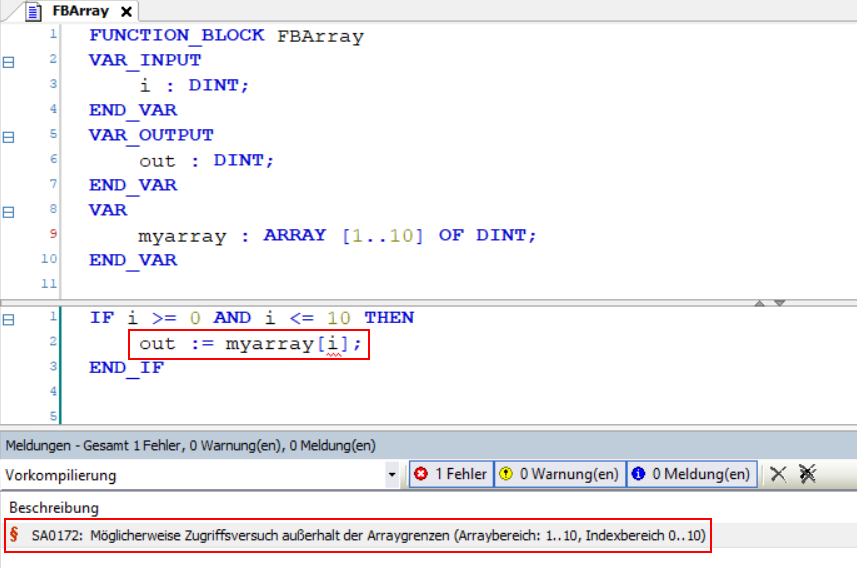

Papenfort: Für die Einstellung der Kamera und die Kalibrierung brauchen wir Wizards. Das macht man nicht in den einzelnen Parametern, sondern man hat dafür entsprechende Tools, die das für einen erledigen. Für die Anwendung der Algorithmen stellen wir Funktionsbausteine zur Verfügung, die jeder SPS-Programmierer kennt. Der Programmierer muss also nicht C++ oder eine grafische Programmiersprache erlernen. Er nutzt die Programmiersprachen, die er schon aus der SPS kennt: IEC61131-3.

Munkelt: Auch Smartphone-Apps haben unterschiedliche Bedienkonzepte. Benutzerfreundlichkeit hat also verschiedene Facetten und ist ein Prozess. Dieser bedingt, dass wir Techniker stärker lernen müssen, zuzuhören, was die Anwender gut finden. Es ist nicht mehr wie vor zehn Jahren, als sie eine Oberfläche für XP geschrieben haben und die so bis in alle Ewigkeit geblieben ist. Die Investitionen, die man benötigt, um das Verständnis für die Benutzerfreundlichkeit zu erhöhen, werden immer größer. Gleichzeitig steigt aber damit auch die Akzeptanz der Systeme. Man muss unterscheiden, zwischen dem, was quasi die Algorithmik einem liefert und zwischen dem, was das Frontend zum Benutzer ist. Es gibt nicht mehr den Zwang, die One-Size-Fits-All Benutzeroberfläche zu haben. Die Anwender sind heute viel eher bereit eine neue Benutzeroberfläche zu akzeptieren, denn das sind sie bereits von ihrem Smartphone gewöhnt.

Ist es nicht gerade der Charme für die Anwender, dass er zukünftig Bildverarbeitung aus einer gewohnten SPS-Umgebung machen kann?

Munkelt: Wir alle möchten gerne das verwenden, was wir schon seit Jahren nutzen. Mir geht es aber darum, dass Ökosysteme wahnsinnig viele Aspekte vereinen. Den Spagat, den diese Systeme machen müssen, ist Anwender anzusprechen, die damit sowohl Motion Control als auch Vision-Aufgaben machen möchten.

Noffz: In der Bildverarbeitung haben wir uns bisher immer auf die Algorithmik konzentriert. Wenn wir zukünftig einen Skalierungseffekt haben wollen, müssen auch die Benutzeroberflächen nachziehen. Allerdings haben wir die Möglichkeit, beide Bereiche zu trennen, weil es im Grunde völlig verschiedene Aufgaben sind. Derjenige, der eine gute Algorithmik entwickelt, muss nicht unbedingt auch eine gute Benutzeroberfläche herstellen. Damit komme ich wieder auf OPC UA Vision. Wir haben zukünftig die Möglichkeit, über eine standardisierte Beschreibung die Ergebnisse eines Bildverarbeitungssystems zu bekommen, d.h. es gibt Firmen, die konzentrieren sich alleine auf die Algorithmik und stellen anschließend die Ergebnisse als eine Art Datenblock zur Verfügung. Daneben gibt es Firmen, die diese Blöcke in ihre Ökosysteme aufnehmen und dort in den gewohnten Nutzerumgebungen darstellen. Das ist eine geschickte Verbindung zwischen dem Algorithmik-Know-how der Bildverarbeiter und den großen Ökosystemen der Automatisierer. (peb)

B&R – Andreas Waldl, Produktmanager Integrated Machine Vision

Balluff – Rainer Schönhaar, Produktmanager Machine Vision

Beckhoff Automation – Dr. Josef Papenfort, Produktmanager Twincat

MVTec Software – Dr. Olaf Munkelt, CEO

Silicon Software – Dr. Klaus-Henning Noffz, CEO

Stemmer Imaging – Peter Keppler, Director of Corporate Sales