Die immer weiter fortschreitende Automatisierung technischer Prozesse wie z.B. in der Fertigungstechnik, bei Transportsystemen, bei Energieverteilungsanlagen oder in Prüfständen und die damit verbundene, für den menschlichen Betrachter nicht mehr direkt erfassbare, Komplexität erfordert Methoden und Hilfsmittel zur Optimierung dieser Prozesse. Eine bewährte Methode, um Komplexität beherrschbar zu machen, besteht darin, das dynamische Prozessverhalten an charakteristischen Stellen zu erfassen, geeignet aufzuzeichnen und dieses dann basierend auf den aufgezeichneten Daten zu analysieren und zu optimieren. Die Datenerfassungsgeräte müssen dafür in der Lage sein, unterschiedliche Prozesswerte und -signale wie Analog- und Digitalsignale, Bussignale, interne Steuerungsdaten, Produktkennwerte, technologische Werte, Kommunikationsdaten und Videobilder zu erfassen, gemeinsam zeitsynchronisiert aufzuzeichnen und langzeitverfügbar abzuspeichern.

Konnektivität für heterogene Systeme

Aufgrund der Heterogenität der verwendeten Automatisierungskomponenten hat es sich in der Praxis als vorteilhaft erwiesen, das Prozessverhalten mit einem unabhängigen externen System zu erfassen und somit eine globale Sicht von außen auf den automatisierten technischen Prozess zu ermöglichen. Es wird daher ein Analysesystem benötigt, das eine breite Konnektivität zu den in den technischen Prozessen verwendeten unterschiedlichen Automatisierungsplattformen besitzt und verschiedene Erfassungsmethoden ermöglicht. Nur mit einem herstellerneutralen System kann das Verhalten komplexer und schneller Prozesse sowie heterogener Automatisierungssysteme, d.h. Systeme, die aus Komponenten mehrerer Hersteller bestehen, zusammenhängend analysiert und optimiert werden. Hierzu wird der Prozess an mehreren Stellen isochron überwacht, um mehrere Prozesskomponenten zueinander in Beziehung zu setzen.

Ziele der Prozessoptimierung

Die Optimierung eines technischen Prozesses und dessen Produkte kann mit ganz unterschiedlichen Zielsetzungen erfolgen. Dabei treten neben Kosten, Qualität und Sicherheitsaspekten auch Umweltgesichtspunkte in den Vordergrund (Bild 3). Der enorme Wettbewerbs-, Zeit- und Kostendruck zwingt Unternehmen, ihre Prozesse hinsichtlich all dieser Kriterien zu perfektionieren. So ist es z.B. nicht möglich, die Qualität eines Produkts isoliert zu verbessern, ohne die durch die Prozessverbesserung verursachten Kosten zu berücksichtigen. Auch ist es selbstverständlich, dass die Sicherheit eines Prozesses für die Prozessbetreiber immer im Vordergrund zu stehen hat. Eine Prozessoptimierung verspricht also nur dann erfolgreich zu sein, wenn alle Kriterien bei der Optimierung berücksichtigt werden.

Komplexität reduzieren

Eine Voraussetzung für die Prozessoptimierung ist es, die technologischen Abläufe im Detail zu verstehen. Nur wenn es gelingt, den Prozess und dessen dynamisches Verhalten mit den Wechselwirkungen zwischen den Prozesskomponenten transparent zu machen, kann dieser auch analysiert und optimiert werden. Da moderne Automatisierungssysteme und die automatisierten Prozesse immer schneller und komplexer werden, sind Hilfsmittel notwendig, um die Komplexität zu reduzieren und diese beherrschbar zu machen. So sind z.B. interne Programmabläufe von außen im Detail nicht beobachtbar, da nur die Auswirkungen nach außen hin sichtbar sind. Außerdem ist es schwierig, vom beobachteten Prozessverhalten auf den Ablauf in der Software zu schließen, da es sich bei Automatisierungssystemen im Allgemeinen um ein sogenanntes \’Verteiltes System\‘ handelt. Es wird demnach mehr als ein Rechner verwendet. Darüber hinaus interagieren mehrere gleichlaufende Software-Programme über verschiedene Kommunikationsmechanismen auf mehreren Steuerungen – also auf mehreren Computern, Rechnern, CPUs und Prozessoren – miteinander und haben zeitliche sowie funktionale Wechselwirkungen. Eine weitere Herausforderung besteht darin, dass es in automatisierten technischen Prozessen kaum reproduzierbare Abläufe und damit keinen zeitlichen Determinismus gibt, da Task-Laufzeiten in Steuerungen vom Prozesszustand, der aktuellen Produktion, externen Umwelteinflüssen (Drucke, Temperatur, etc.) oder dem aktuellen Anlagenzustand (Verschleiß, Alterung, etc.) abhängen. Dies führt zu einer Komplexität, die für den Menschen ohne Hilfsmittel nicht mehr beherrschbar ist.

Gefahr bei undurchsichtigen Systemen

Nicht beherrschte Komplexität bei Automatisierungslösungen birgt die Gefahr potenzieller Instabilitäten in allen Phasen des Lebenszyklus einer Anlage. So haben bei der Inbetriebsetzung Instabilitäten im Prozess und nicht beherrschte Komplexität in der Regel eine erhebliche Verzögerung zur Folge, was im Extremfall auch zu einer nicht vollständig funktionierenden Anlage führen kann. Im Produktionsalltag führen Instabilitäten zu Störungen, deren Ursachen nicht sofort lokalisierbar sind und die damit unmittelbare Auswirkungen auf Produktqualität, Anlagensicherheit und -verfügbarkeit haben. Beispiele für Störungstypen sind sogenannte sporadische Fehler, deterministische Fehler im Zeitverhalten, die langsame Verschlechterung der Qualität der Produkte bzw. der Anlagen sowie Störmeldungen ohne erkennbare Ursache. Fast alle sporadischen Fehler (Brüche, Verstopfungen, plötzliche Schwankungen, Kurzschlüsse, Kommunikationsstörungen, etc.) sind in Wahrheit systematische Fehler, die aber aufgrund unvollständiger Systemdurchdringung nicht ausreichend durchschaut werden konnten. Nehmen deterministische Fehler zu oder Qualität und Maßhaltigkeit ab (Ermüdung, Abrieb, Verschmutzung, Korrosion, Alterung, etc.), so sind die Gründe hierfür ebenfalls systematischer Natur. Es handelt sich folglich um sporadische Störungen, die aufgrund der Systemkomplexität hinsichtlich ihrer Kausalität als nicht durchdringbar und damit nicht vorhersehbar oder vermeidbar erscheinen.

Störungen überwachen und vermeiden

Ein weiterer wichtiger Aspekt beim Betreiben automatisierter Prozesse ist die Vermeidung kritischer Prozesssituationen, die Auswirkungen auf die Anlagen-/Arbeitssicherheit oder die Umwelt haben können. Hier muss es nicht nur möglich sein, Störungen frühzeitig zu detektieren und zu melden, sondern Störungen durch eine kontinuierliche Überwachung des Anlagenzustands ganz zu vermeiden und die Ursachen, die zu einer Störung hinführen können, bei deren Auftreten sofort aufzuzeigen (root cause analysis). Störungen, die im Allgemeinen sukzessiv und schleichend eintreten, sind schwer zu erkennen. Dies kann dazu führen, dass diese Störungen mitunter erst beim Abnehmer des Produkts (Endkunden) aufgedeckt werden, was schwerwiegende wirtschaftliche Auswirkungen haben kann. Solche Auswirkungen sind finanziell nicht zu kalkulieren, können sie doch langfristig betrachtet schwerwiegende Auswirkungen auf Geschäftsbeziehungen haben. Auch wenn der Prozesszustand in automatisierten Prozessen mit Hilfe von Sensorik und Messtechnik immer besser erfasst wird und die Messwerte den Prozesszustand gut abbilden, so können aufgrund des dynamischen Zeitverhaltens und der Schnelligkeit der Prozesse Ursache und Wirkung trotzdem nicht einfach bestimmt werden. Abläufe in Steuerungen oder gar in Steuerungsverbunden sind nicht transparent – bildlich gesprochen: es gibt keinen Tastsinn für Software. Daher müssen Verfahren gefunden werden, die das dynamische Prozessverhalten nach außen hin transparent und analysierbar machen. Dies ist die Grundlage für die Systemoptimierung, d.h. für die Prozess- und Produktoptimierung unter Kosten-, Qualitäts-, Sicherheits- und Umweltgesichtspunkten.

Prozessanalyse in vier Schritten

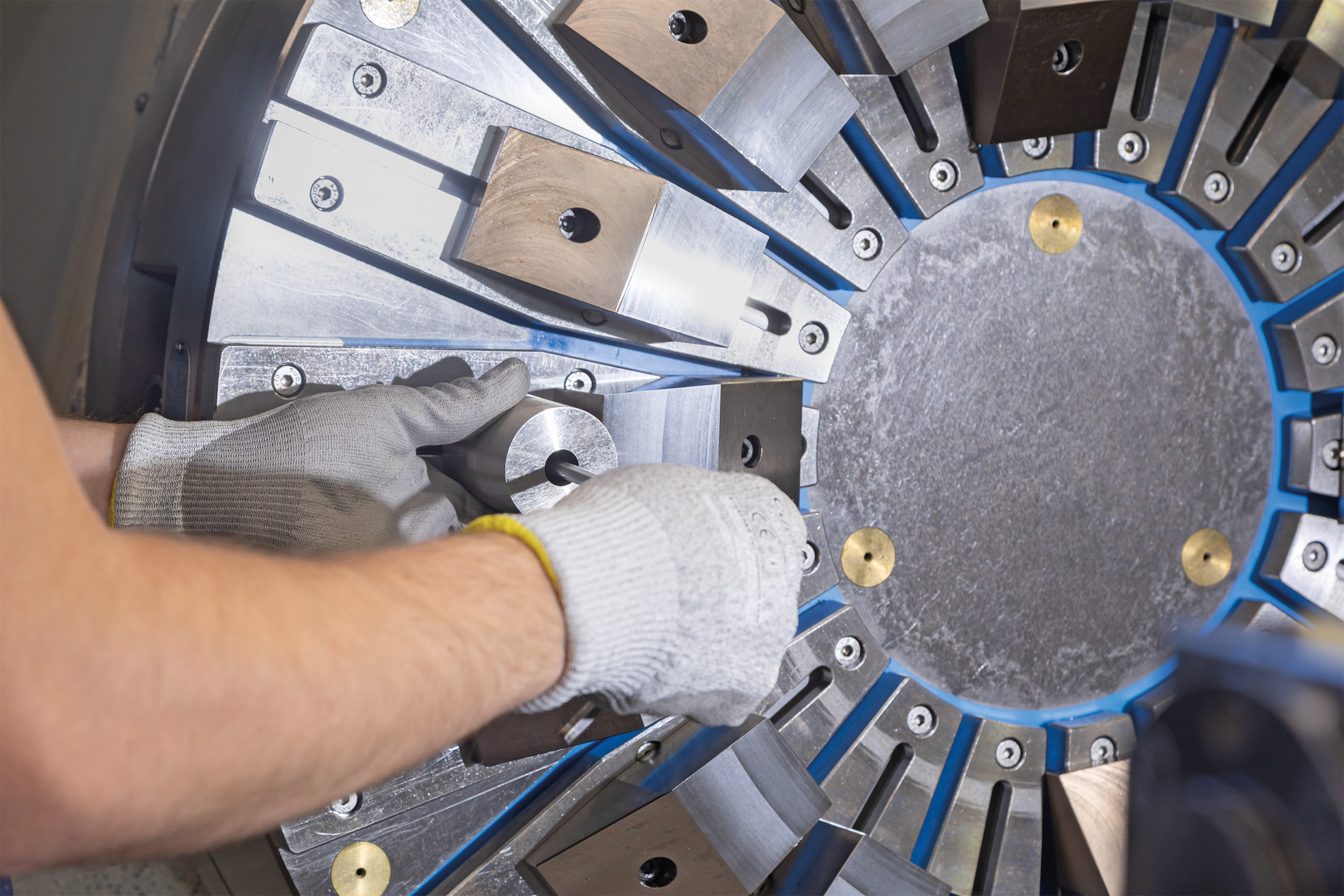

Voraussetzung für die Prozess- und Produktoptimierung ist zunächst die Analyse des Prozesses. Idealerweise bietet sich ein vierphasiges Vorgehensmodell an: Datenerfassung, Datenaufzeichnung, Datenauswertung und Informationsgewinnung (Bild 2). Bei der Datenerfassung geht es zunächst um die Erfassung des dynamischen Prozessverhaltens durch geeignete Messverfahren und Sensorik an ganz unterschiedlichen Stellen im Prozess. Unter Datenaufzeichnung ist die Aufzeichnung der erfassten Messdaten und deren Speicherung zu verstehen. Im nächsten Schritt werden die Daten aufbereitet, analysiert und durch multimediale und interaktive Analyseinstrumente ausgewertet. Aus diesen drei Phasen resultiert die letzte, die der Informationsgewinnung. Aus den Messdaten und Analyseergebnissen werden Informationen gewonnen und Wissen abgeleitet, um die Qualitätsdaten und Management-Kennzahlen zu berechnen, sog. Key Performance Indicators (KPIs). Auch wenn diese vier Phasen aufeinander aufbauen, so darf hier nicht der Eindruck entstehen, dass die einzelnen Phasen streng sequentiell nacheinander ablaufen. Vielmehr müssen Datenerfassung (Phase 1) und -aufzeichnung (Phase 2) kontinuierlich erfolgen, da Messdaten für die Berechnung von Qualitätsdaten vollständig und lückenlos erfasst werden müssen. Zudem ist im Voraus nicht vollständig erkennbar und vorhersagbar, welche Messdaten für eine Prozessanalyse benötigt werden. Während also in Phase 3 und Phase 4 die Auswertung und Analyse der Daten erfolgt, werden parallel dazu weitere erfasst und aufgezeichnet. Die Optimierung eines Anlagensystems erfordert eine hundertprozentige Datenverfügbarkeit. Nur wenn Messdaten kontinuierlich und von jedem Zeitpunkt vorliegen, ist im Störfall eine umfassende Analyse möglich, und nur dann können aus den Messdaten kontinuierlich und automatisch Qualitätsdaten und KPIs erzeugt werden.

Auswertung ist iterativer Vorgang

Art und Detail der in der Datenauswertung und Informationsgewinnung durchgeführten Auswertungen sind sicherlich vom Anlagenzustand abhängig. So wird die interaktive Analyse des Prozesses oft nur im Störfall oder bei Betrachtung bestimmter Optimierungsaufgaben durchgeführt. Werden jedoch die Messdaten auch dazu verwendet, automatisch Qualitätsdaten zu erzeugen, die zum Nachweis der Produktqualität sowohl für interne Langzeitauswertungen als auch gegenüber dem Endkunden verwendet werden, so ist offensichtlich, dass die Datenerfassung und -aufzeichnung kontinuierlich zu erfolgen hat und nicht unterbrochen werden darf. Insgesamt ist das Vorgehensmodell als Ganzes ein iterativer Vorgang, da Ergebnisse der Datenauswertung und Informationsgewinnung in der Regel Auswirkungen auf die weitere Datenerfassung haben. Im Allgemeinen ist erst nach einer Auswertung offensichtlich, wie die Abläufe im Prozess tatsächlich sind und welche Signale und Messwerte für weitere Analysen noch fehlen. Erst wenn bekannt ist, wo die Schwachstellen und Fehlermöglichkeiten sind, kann auch gezielt nach diesen gesucht werden. So ist eine Erweiterung der Messpunkte und Nachinstrumentierung für die Prozessoptimierung eine normale Vorgehensweise. Das Zusammenspiel der vier Phasen, sowie deren flexible Ausführung in einer werkzeuggestützten Umgebung ermöglicht es, das dynamische Zeitverhalten eines Prozesses transparent und damit analysierbar zu machen. Basierend auf den aufgenommenen und aufbereiteten Daten (Bild 1) können dann Störungen und deren Ursachen erkannt sowie die nötigen Schritte zur Optimierung des Systems unter Kosten-, Qualitäts-, Sicherheits- und Umweltgesichtspunkten unmittelbar abgeleitet werden. Das vierstufige Vorgehensmodell gibt einerseits einen klaren Weg für die Prozessanalyse als Basis für die Prozessoptimierung vor. Jedoch ist damit auch klar, dass es nur mit einem übergreifenden Datenerfassungs- und Analyse-System möglich ist, die Komplexität einer kompletten Anlage zu beherrschen, um das dynamische Prozessverhalten transparenter zu machen. Im zweiten Teil der Serie erfahren Sie, wie unterschiedliche Prozesswerte und -signale zeitsynchron aufgezeichnet und wie mit Hilfe von Datenerfassung Zusammenhänge in automatisierten Prozessen offengelegt werden.