Wie funktioniert Physical AI?

Generative KI-Modelle – darunter Sprachmodelle wie GPT und Llama – werden mit großen Mengen an Text- und Bilddaten trainiert. Diese KIs beeindrucken durch ihre Fähigkeit, menschliche Sprache zu erzeugen und abstrakte Konzepte zu entwickeln. Ihr Verständnis der physischen Welt und ihrer Regeln ist jedoch begrenzt, es fehlt der räumliche Kontext.

Generative physische KI erweitert bestehende generative KI-Modelle um die Fähigkeit, räumliche Beziehungen und physische Vorgänge in unserer dreidimensionalen Welt zu verstehen. Diese Erweiterung wird durch die Integration zusätzlicher Daten in den Trainingsprozess der KI ermöglicht, die Informationen über räumliche Strukturen und physikalische Gesetze der realen Welt enthalten.

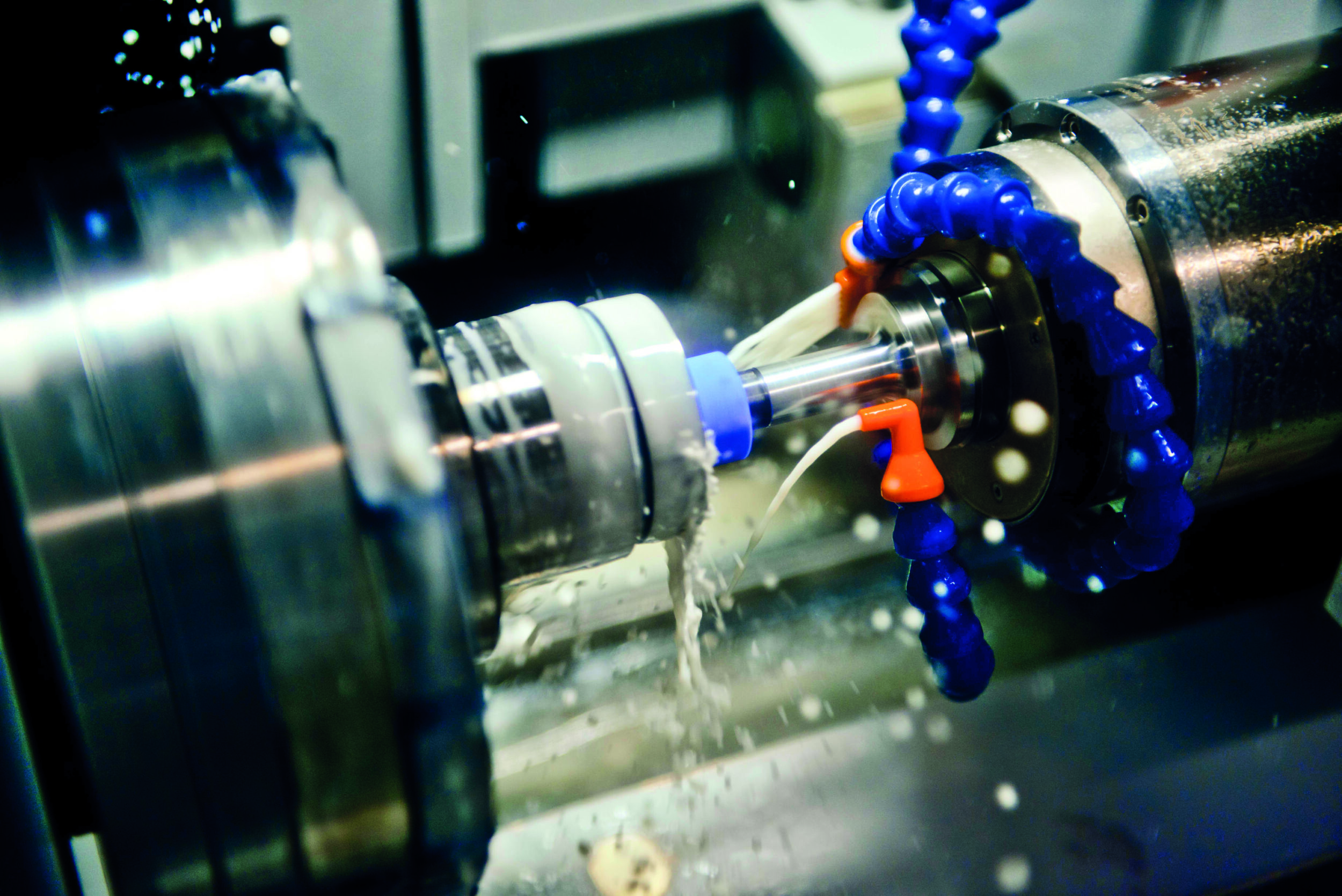

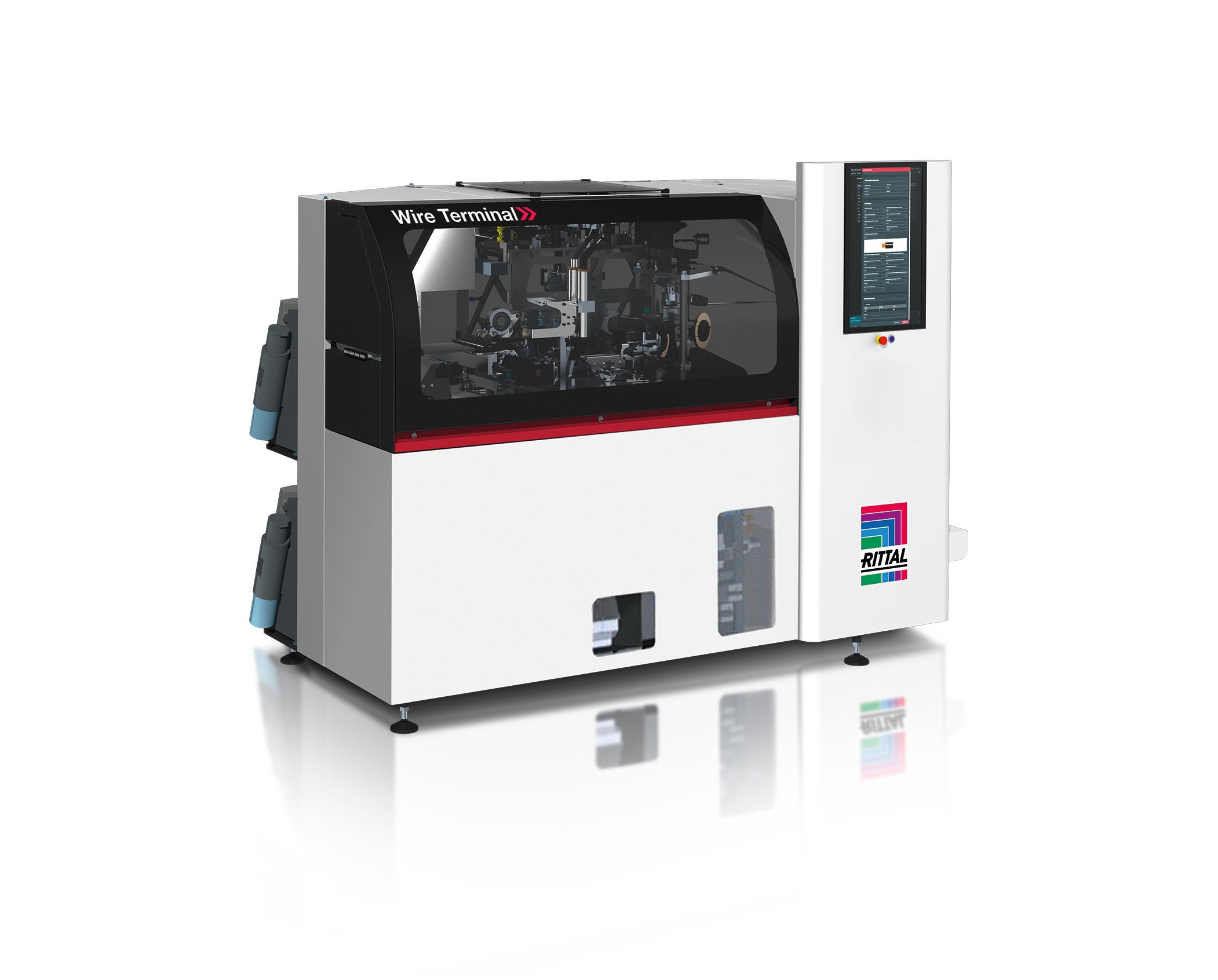

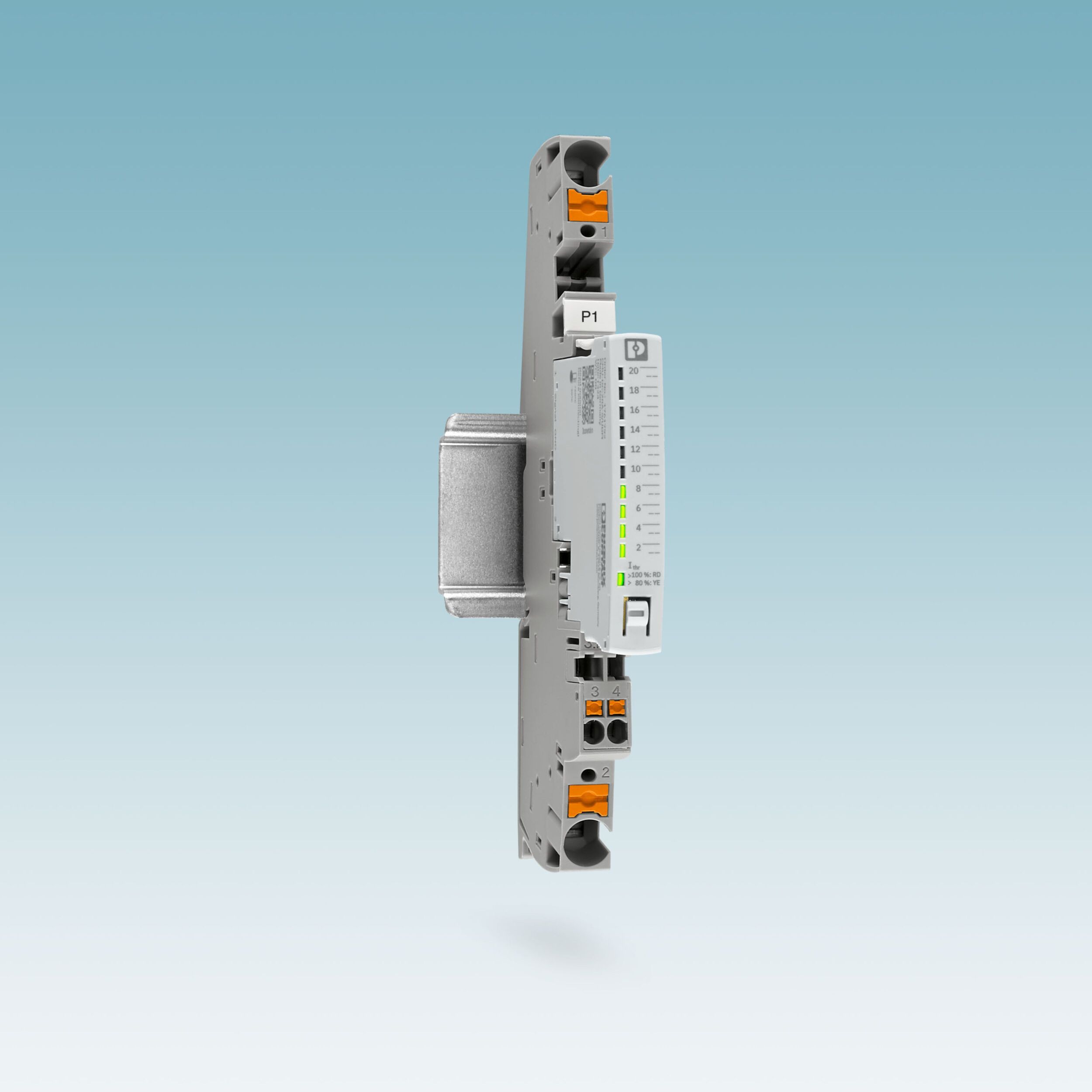

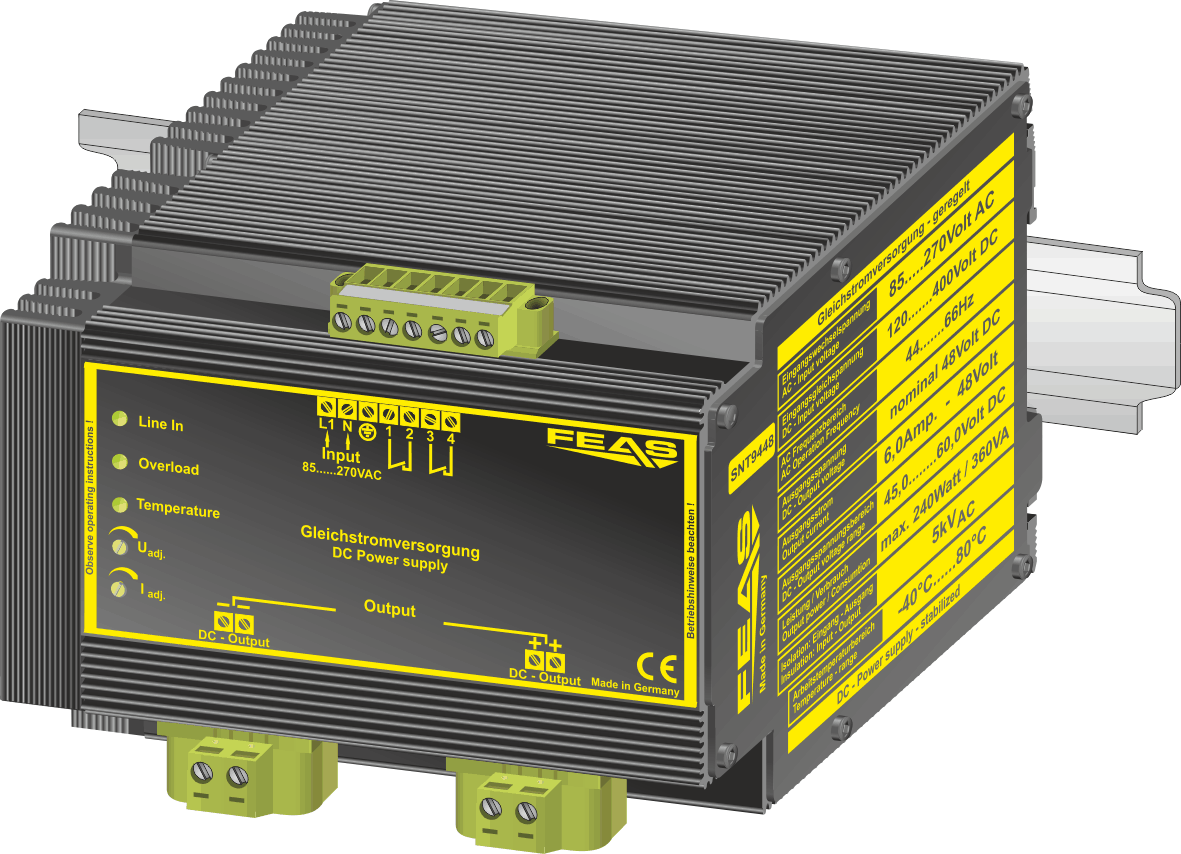

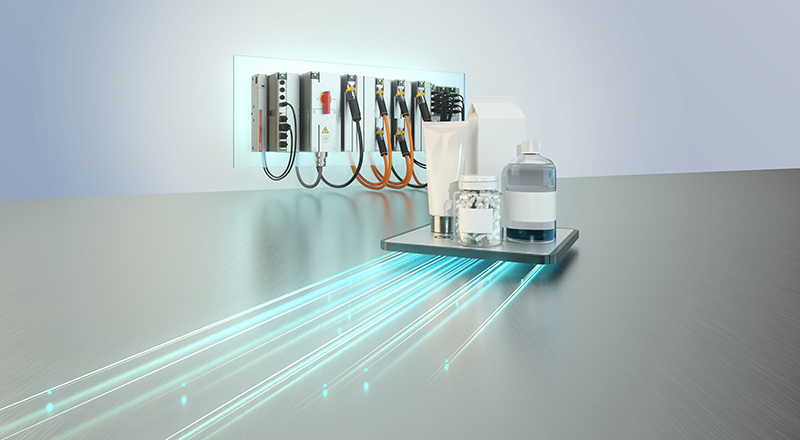

Die 3D-Trainingsdaten, die sowohl als Quelle als auch als Umgebung für das KI-Training dienen, werden mithilfe hochpräziser Simulationen erzeugt. Automatisierungstechnik von Beckhoff ermöglicht die effiziente Entwicklung ressourcenschonender Verpackungsmaschinen, verkürzt Konstruktionszeiten und senkt Kosten – für innovative Lösungen und nachhaltige Produktionsprozesse. ‣ weiterlesen

Vorsprung im Packaging

Die physikbasierte Datengenerierung beginnt mit der Erstellung eines digitalen Zwillings, beispielsweise einer Fabrik. In diesem virtuellen Raum werden Sensoren und autonome Maschinen wie Roboter integriert. Anschließend werden reale Szenarien auf Basis von physikbasierten Simulationen durchgeführt, bei denen die Sensoren verschiedene Interaktionen erfassen, wie die Dynamik von starren Körpern – zum Beispiel Bewegungen und Kollisionen – oder die Interaktion von Licht mit seiner Umgebung.

Welche Rolle spielt Reinforcement Learning?

Reinforcement Learning ermöglicht es autonomen Maschinen, in simulierten Umgebungen Fähigkeiten zu entwickeln, die sie anschließend in der realen Welt anwenden können. Mit dieser Methode lernen Maschinen durch beliebig viele Iterationen neue Fähigkeiten in einer sicheren Umgebung.

Durch diese Technologie werden Physical AI-Modelle für die erfolgreiche Ausführung von Aufgaben in der Simulation belohnt, wodurch sie sich kontinuierlich anpassen und verbessern. Durch wiederholtes Training lernen autonome Maschinen, sich an neue Situationen und unvorhergesehene Herausforderungen anzupassen, die sie für den Einsatz in der realen Welt vorbereiten. Mit der Zeit entwickeln sie ausgefeilte feinmotorische Fähigkeiten für praktische Anwendungen wie das präzise Verpacken von Kisten, die Unterstützung von Produktionsschritten oder die autonome Navigation in komplexen Umgebungen.

Warum ist Physical AI wichtig?

Bislang konnten autonome Maschinen ihre Umgebung nicht umfassend wahrnehmen und interpretieren. Generative Physical AI ermöglicht es nun, Roboter zu entwickeln und zu trainieren, die nahtlos mit der realen Welt interagieren und sich flexibel an wechselnde Bedingungen anpassen können.